規模に応じたコストの監視

組織が生成AIのユースケースを増やすにつれて、リーダーは 「どれくらいのコストがかかるのか 」という疑問を解明しようとしています。

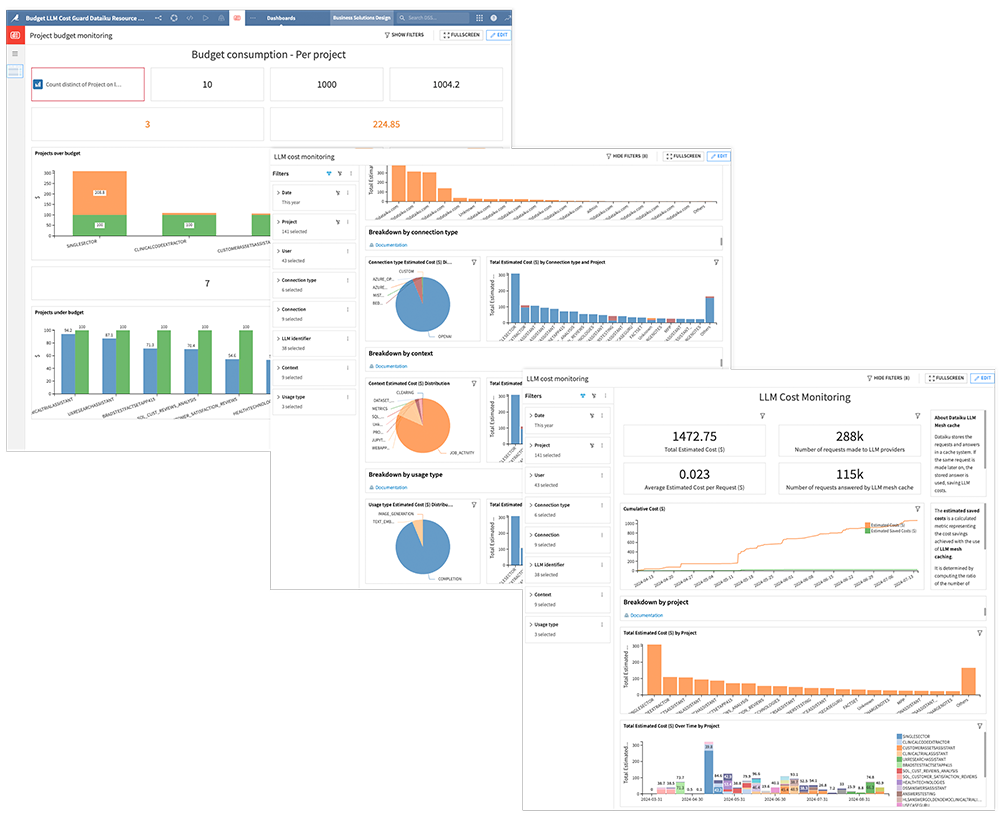

コストガードを使用することで、ITチームはすべてのチームに渡るコストとLLMの使用に関する最新のデータを分析することができます。あらかじめ構築されたダッシュボードは、ユースケース、ユーザー、プロジェクトごとに詳細なレポートを提供し、監査可能なLLM使用ログは、正確なコスト追跡と社内再請求を可能にします。

組織が生成AIのユースケースを増やすにつれて、リーダーは 「どれくらいのコストがかかるのか 」という疑問を解明しようとしています。

コストガードを使用することで、ITチームはすべてのチームに渡るコストとLLMの使用に関する最新のデータを分析することができます。あらかじめ構築されたダッシュボードは、ユースケース、ユーザー、プロジェクトごとに詳細なレポートを提供し、監査可能なLLM使用ログは、正確なコスト追跡と社内再請求を可能にします。

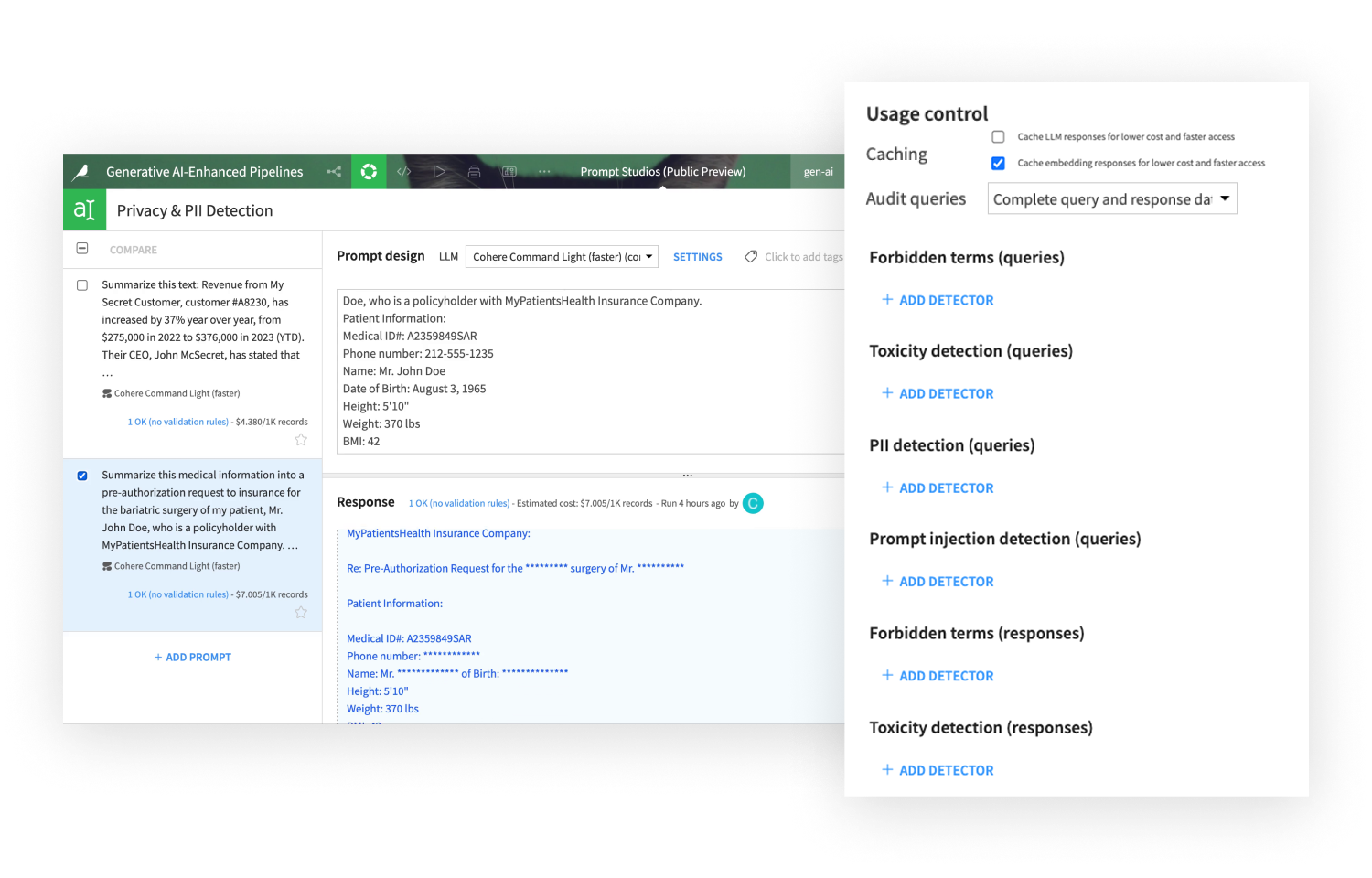

組み込みの使用管理機能により、データセキュリティーの維持、レピュテーションの完全性の確保、AI アプリによる意図しない被害の回避をサポートします。

安全性ガードは、個人を特定できる情報(PII)、有害なコンテンツ、禁止用語、プロンプトインジェクションの試みなど、センシティブな情報や悪意のある行為についてリクエストとレスポンスを評価します。そして、LLMにリクエストを送信する前に機密情報を再編集したり、リクエストを完全にブロックしたり、管理者に警告を発したりするなど、適切なアクションを実行します。

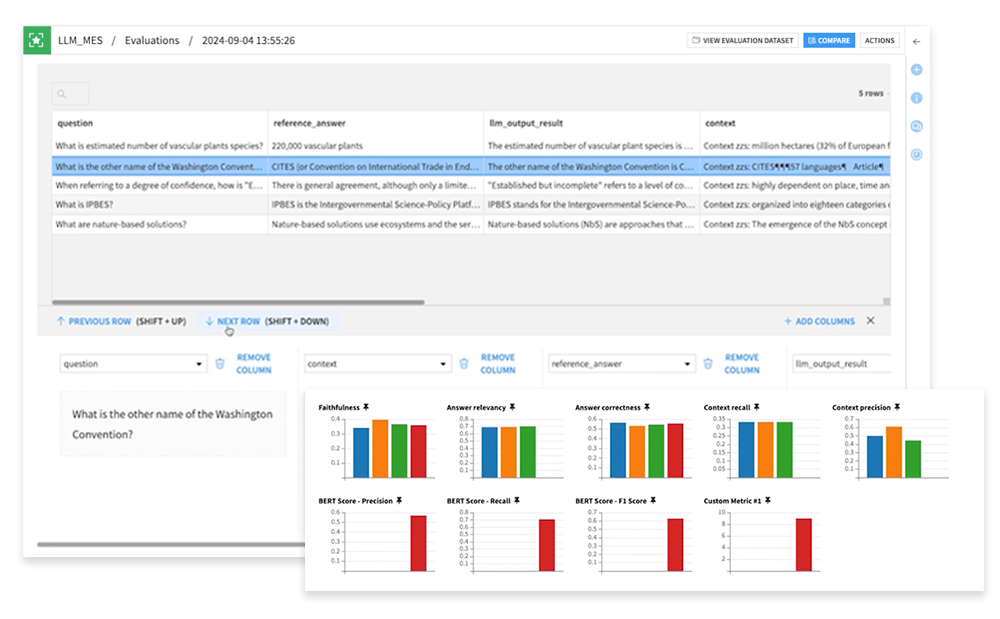

LLMの評価とモニタリングのための標準化されたツールと自動化されたLLMOpsにより、概念実証(POC)から本番まで高い品質を保証します。

Dataiku クオリティーガードは、生成AI固有の品質指標とモデル結果のサイドバイサイド比較を提供し、最高性能のAIシステムを確実に導入します。

コスト監視は重要ですが、可能な限りコストを削減することも重要です。

Dataiku LLMメッシュは、一般的なクエリに対するレスポンスをキャッシュするオプションを提供しています。つまり、レスポンスを再生成する必要がなく、コスト削減とパフォーマンス向上の両方を実現します。セルフホスティングの場合は、ローカルHugging Faceモデルをキャッシュして、ストレージインフラにかかるコストを削減することもできます。

コスト削減はコストガードのダッシュボードで自動的に視覚化されるため、キャッシュ戦略を改善、強化することができます。